Niekontrolowany rozwój sztucznej inteligencji może zniszczyć ludzkość, uważa prof. Andrzej Zybertowicz. Żeby zapobiec temu zagrożeniu potrzebne są zdecydowane kroki. Problem w tym, że w demokracji, która została zdegenerowana przez media społecznościowe, skrajnie mało realistyczne jest zdobycie się na takie działania…

O problemie prof. Andrzej Zybertowicz mówił w programie PCh24 TV. Red. Paweł Chmielewski rozmawiał z nim na temat AI na kanwie książki „AI. Eksploracja”. – Według technoentuzjastów przyszłość ma wyglądać wspaniale. Nie będzie niedostatku, nie będzie biedy, nie będzie chorób. Może nie będzie starości, a jeśli będzie, to pogodna, bo będziemy żyli długo w zdrowiu – powiedział.

– Nie będzie wojen, nie będzie żadnych podwyżek energii, nie będzie dezinformacji, nie będzie manipulacji, a ponieważ nie będziemy musieli zajmować się żadnymi męczącymi, nużącymi, niszczącymi zdrowie czy emocje pracami, to będziemy mogli być artystami, reformatorami, a może nawet eksplorować najbardziej odległe galaktyki. Inaczej mówiąc, czeka nas coś na podobieństwo raju – dodał.

Wesprzyj nas już teraz!

– W Dolinie Krzemowej, wśród najbogatszych ludzi świata, którzy mają dziesiątki miliardów dolarów, jest przekonanie, że jesteśmy u progu zbudowania technologii, które wyprowadzą ludzkość ku iście rajskiej przyszłości – wskazał.

Według prof. Zybertowicza technoentuzjazm jest jednak „najbardziej niebezpieczną ideologią współczesności”.

Jak wyjaśnił uczony, dla części technoentuzjastów człowiek jest tylko „pewnym ogniwem w procesie już nawet nie ewolucji, ale technoewolucji”. – Ogniwem, które jest drabiną, po której ewolucja wejdzie na wyższy etap i wtedy tę drabinę odrzuci. […] Człowiek tak, jak został uformowany historyczni czy też w kształcie danym przez Boga, nagle staje się przeszkodą w rozwoju jakichś wyższych, cudownych umysłów. […] Dla nich człowiek jest balastem, przeszkodą, którą trzeba wyminąć albo po prostu zlikwidować – podkreślił.

Jak dodał, są też technoentuzjaści, którzy myślą w innych kategoriach, to znaczy sądzą, że rozwój technologiczny pozwoli rozwiązać różne problemy, ale nie oczekują ani nie dążą do zmiany samego człowieczeństwa.

Według prof. Zybertowicza technoentuzjaści nie kierują się w pierwszej kolejności pragnieniem kontroli. Zastanawiając się nad motywacjami, które napędzają dążność do rozwoju AI, wskazał na ciekawość. – Sztuczna inteligencja nie weszłaby na obecny poziom, gdyby nie to, że dla setek wybitnych umysłów ciekawość była głównym impulsem pchając ich do działania – powiedział.

Problem w tym, że rzecz może zakończyć się fatalnie. Powołał się na Geoffrey’a Hintona, laureata Nagrody Nobla w dziedzinie fizyki z 2024 roku. Hinton jest jednym ze współtwórców obecnych modeli AI. Po dziesięciu latach pracy w Google – zrezygnował. Jak tłumaczył, chciał mieć swobodę wypowiedzi, a nie być na uwięzi korporacji; ale chodziło o coś więcej. Wyznał, że „jakaś jego część” żałuje, że przyłożył rękę do rozwoju AI. Jak wskazał, z historii wynika, że kiedy dochodziło do spotkania cywilizacji wyższej z niższą – zawsze dochodziło do ludobójstwa. Chcąc nie chcąc, tak kończyły się te spotkania. Jeżeli zatem AI uzyska zdolności myślowe przekraczające umiejętności ludzkie…

W rozmowie dotknięto następnie wpływu AI na system polityczny. – Technologie internetowe, zwłaszcza media społecznościowe, spowodowały strukturalne zatrucie ludzkiej infosfery, ciągłe przeciążenie informacjami, które w znacznej mierze są nieprawdziwe i nonsensowne. Sprawiają, że tracimy zdolność do odróżniania nie tylko prawdy od fałszu, dobra i zła, ale również ważnego od nieważnego. Spędzamy ogromną ilość czasu w kontaktach z takimi gadżetami, w których są zaszyte dziesiątki, jeśli nie setki różnych modeli sztucznej inteligencji i poprzez algorytmy zarządzają informacjami, jakie do nas dotrą. Następuje degradacja naszych zdolności poznawczych – wskazał.

Media społecznościowe zdruzgotały komunikację polityczną. – A zdruzgotana komunikacja polityczna osłabiła proces rekrutacji elit politycznych. Ludzie, którzy wypowiadają się rzeczowo i na poziomie, spokojnie i z szacunkiem dla innych, tracą w infozgiełku siłę przekazu. Nawet uczciwi politycy, którzy, by tak rzec, mają Boga w sercu, prymitywizują swój przekaz, żeby przebić się przez ten infozgiełk. Ulegają pokusom medialnym, żeby hejtować – wskazał.

Przyznał, że on sam bywał zachęcany przez dziennikarzy do tego, by kogoś ostro zaatakować, tak, żeby potem można było to sprzedać pod hasłem „doradca prezydenta brutalnie wyraził się” na czyjś temat. To byłoby dobre pod względem kilkalności.

– Ci dziennikarze nie muszą być złymi ludźmi, ale są częścią maszynerii, która spłaszcza komunikację. A spłaszczona komunikacja wiąże się z pogorszeniem jakości polityków. Politycy, którzy nie rozumieją wyzwań swojego czasu, przyczyniają się do degradacji instytucji tworzących proces ustawodawczy – wskazał.

Mamy zatem z jednej strony zdegradowany proces demokratyczny, a z drugiej wielosetmiliardowe fortuny gigantów z Doliny Krzemowej – oraz z Chin, gdzie również działają giganci cyfrowi, jak choćby szefowie TikToka.

– TikTok jest jednym z największych degeneratorów ludzkiej psychiki. To chiński wynalazek, sterowany przez algorytmy sztucznej inteligencji – powiedział. Jak twierdzą niektórzy eksperci, algorytmy są skonstruowane tak, by do obywateli Chin kierować treści bardziej prospołeczne i odpowiedzialne, a na Zachodzie pokazywać szmelc.

Jak rozwiązany zostanie ten problem? Prof. Zybertowicz odwołał się do Jacka Dukaja. Swego czasu Dukaj na łamach „Gazety Wyborczej” napisał, że żeby opanować problem technologicznego infozgiełku będzie trzeba w jakiś sposób wycofać się z demokracji. Według Zybertowicza, jest to prawdopodobnie trafna intuicja. W jego ocenie rozwój AI przynosi obecnie więcej zagrożeń niż korzyści i trzeba go będzie powstrzymać. Prawdopodobnie nie da się tego zrobić w ramach procedur demokratycznych, bo trwa obecnie cyfrowy „wyścig zbrojeń” – ale inaczej niż w czasie zimnej wojny, nie jest kontrolowany przez państwa, bo uczestniczą w nim także prywatne firmy.

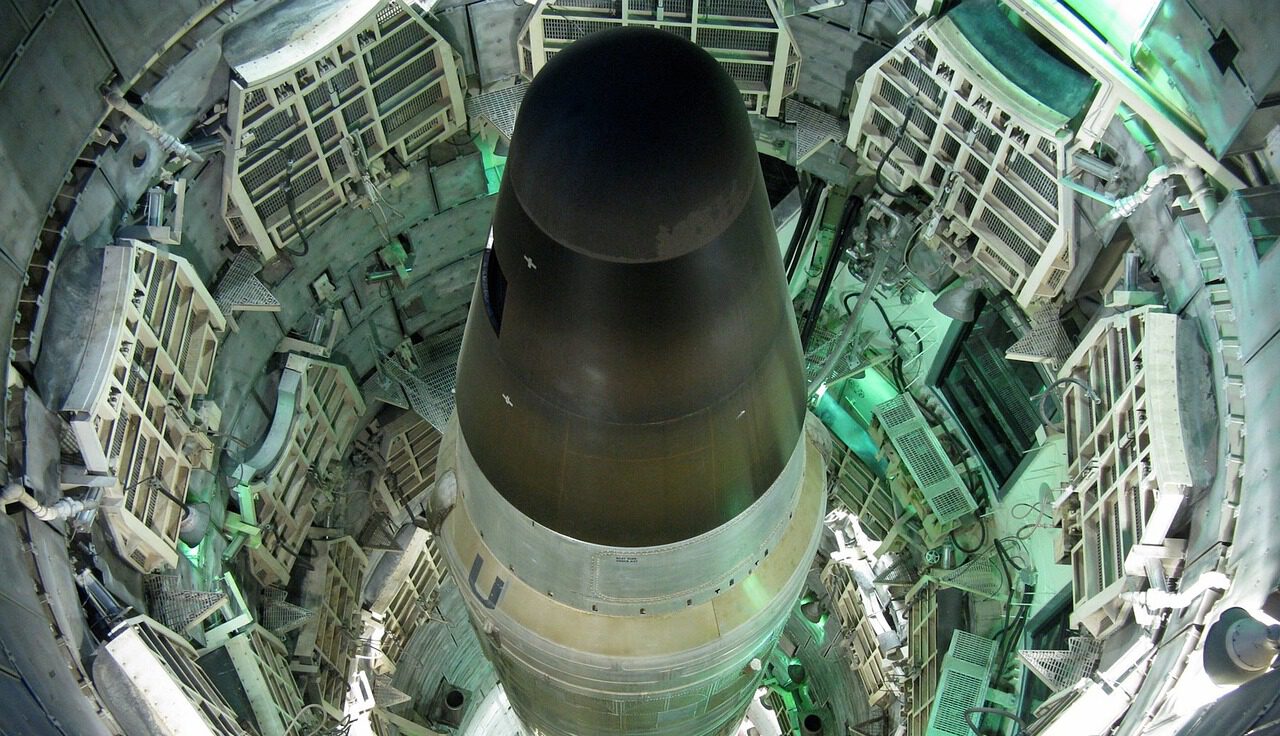

Może być tak, wskazał, że „bez złamania paradygmatu demokracji… nie ocalimy człowieczeństwa”. Jest przecież teoretycznie możliwe, że AI przejmie kontrolę nad systemami zbrojeniowymi, w tym nad bronią nuklearną. W jego ocenie są w efekcie trzy zasadnicze rozwiązania: dialogowe i demokratyczne; półdemokratyczne; rozwiązanie pojawi się samo na skutek brutalnego wstrząsu.

Według uczonego ścieżka demokratyczna jest po prostu bardzo mało realistyczna, szansę na jej realizację są wręcz bliskie zeru. Chodziłoby w niej o to, by politycy demokratyczni mówili otwarcie o tym, co jest konieczne i z jakimi kosztami się to wiąże; jednak we współczesnej demokracji – którą nazywać można nawet memokracją – po prostu by nie wygrali.

Drugim rozwiązaniem, półdemokratycznym, jest droga związana ze swoistym deep state. – Czołowi analitycy, stratedzy, szefowie służb i wielkich korporacji zrozumieją to, o czym mówią eksperci od AI. Zrozumieją te zagrożenia – i poniżej radaru opinii publicznej dojdzie do porozumienia ludzi, którzy reprezentują, nazwijmy to, autorytarny styl myślenia w USA, Chinach, Izraelu, Iranie, Rosji, innych kluczowych państwach. Zrozumieją, że cyfrowy wyścig zbrojeń może się wymknąć pod kontroli każdemu, bo w momencie, gdy cyfrowy wyścig zbrojeń doprowadza do sztucznej inteligencji zdolnej do autonomicznego wyznaczania swoich celów, to nie wiemy, jakie to będą cele. Mogą być cele dla nas opłakane – zaznaczył prof. Andrzej Zybertowicz.

W jego ocenie prawdopodobieństwo takiego rozwiązania jest wprawdzie wyższe niż w wersji demokratycznej, ale nadal niskie.

Trzecim wreszcie rozwiązaniem jest sytuacja, w której na skutek rozwoju AI dojdzie do poważnej katastrofy. – Zginą miliony, setki milionów ludzi i wtedy wszyscy się ogarną, mówiąc: trzeba było słuchać tych, którzy mówili o konieczności zatrzymania tego rozwoju, bo trzeba to mieć pod kontrolą – wskazał. „Optymizm” tego scenariusza polega na tym, że kataklizm będzie jednocześnie na tyle wyraźny, by skłonić ludzkość do działania, ale nie na tyle silny, by ludzkość zniszczyć. W tle zawsze możliwy jest jeszcze inny scenariusz: kataklizm, który ludzkość po prostu likwiduje.

Więcej w PCh24 Tv.

Pach