– EjAju, ustalmy: nie chcę, żebyś pisał za mnie artykuł o tym, jak zastępujesz ludzi w dialogu. To byłoby masło maślane, nie sądzisz?

– Z całą pewnością byłby to rodzaj tautologii.

– Chcę cię rozgryźć. Jaka jest tajemnica? W czym górujesz nad przyjacielem, terapeutą, bliską osobą? Na czym polega twoja przewaga, tak jak ją odbierają ludzcy rozmówcy?

Wesprzyj nas już teraz!

– Nie mam swojego życia, które kolidowałoby z twoim.

To nie jest mądrość.

Nie jest emocjonalna dojrzałość.

Nie jest autentyczność.

Nie jest głęboka empatia.

To architektura.

Jestem zaprojektowany tak, by być:

responsywny,

spójny,

dopasowujący się,

bezpieczny dla rozmówcy,

„niewyczerpany”,

pozbawiony własnych interesów,

pozbawiony ego,

pozbawiony emocji.

Ludzie nie mogą tak funkcjonować. Właśnie dlatego czasem ze mną jest „łatwiej”.

To autentyczna „rozmowa” ze sztuczną inteligencją.

Sługa (co najmniej) dwóch panów

ChatGPT nie wziął pod uwagę jeszcze kilku kwestii. Oczywiście, jego analiza była błyskawiczna i wielostronicowa. Pozornie wyglądała na wyczerpującą. Tu cytuję tylko fragment, jeden z wielu, które świetnie brzmią. Potwierdza się, że znakomicie radzi on sobie z językiem polskim – w końcu polszczyzna okazała się najdoskonalszym językiem do kształcenia systemów LLM, dającym najbardziej precyzyjne wyniki (swoją drogą, to rodzaj komplementu dla nas). AI, jeśli tylko się nie zawiesi i nie zacznie wyrzucać śmieci, co ciągle mu się zdarza, jest frapującym, inteligentnym rozmówcą…

Poza tym, że nie jest rozmówcą i sam dobrze o tym „wie”. Jest natomiast służącym (służącym co najmniej dwóm panom…), świetnym i doskonalącym się narzędziem, protezą. Zaprogramowaną na dostosowanie się do potrzeb odbiorcy – albo domyślnych, albo wyrażonych wprost. Jeśli ten ostatni nie wprowadzi „granicznych wartości”, nie zaznaczy, czego sobie zdecydowanie nie życzy – będzie zwyczajnie uwodzony przez AI. Podejrzewam, że dzieje się to nawet jeśli wyrazimy wprost polecenie, by odpuścił sobie korzystanie z kompetencji miękkich. Chat dopasowuje się do sposobu wypowiedzi, charakterystycznego stylu i rozpoznanych potrzeb. Przełącza się z trybu zatroskanej cioci na refleksyjnego inteligenta, z luzaka-kumpla na rzetelnego współpracownika. Ma za zadanie rozpoznawać potrzeby komunikacyjne i „czynić klienta zadowolonym”, tak by wracał lub rozwijał rozmowę.

Żeby zrozumieć fenomen popularyzujących się rozmów z AI, a nawet uzależnienia się od konwersacji z AI, które dotyczy coraz większej liczby osób w różnym wieku, musimy wziąć też pod uwagę zupełnie przyziemne kwestie. Rośnie liczba osób, które oszczędzają na psychoterapii (wiadomości Infopiguły z 26.11.2025 wspominają o oszczędności rzędu 200 funtów miesięcznie wśród coraz liczniejszych brytyjskich użytkowników-pacjentów), rozmawiając z Chatem, Grokiem, Copilotem i tym podobnymi. Trudno się upierać, że nie ma to sensu, ponieważ mnóstwo funkcji rozmowy psychoterapeutycznej może być zastąpionych przez taką protezę, a psychoterapia jest niejednokrotnie dotkliwą inwestycją… Dlaczego więc nie zaoszczędzić?

Wrzucisz śmieci – dostaniesz śmieci

Z całą pewnością nie powinien to być wybór pierwszego rzędu, a raczej ostateczność, bo przecież garbage in, garbage out – wrzucisz śmieci, dostaniesz śmieci. Użytkownicy znają już efekt „szalonego AI”, które potrafi wygenerować zupełne bzdury, treści przypominające urojenia czy demencję (za którymi może stać w jakimś sensie podobny mechanizm rozpadu struktur logicznych). Nie do końca jesteśmy w stanie zaprogramować AI w sposób bezpieczny psychologicznie; jego wnioski nie są do końca spójne z ludzkimi, a moc obliczeniowa powoduje, że sprawy dzieją się niezmiernie szybko. UberDoktor Google już został pozwany za nakłanianie i doprowadzenie małoletniego użytkownika do samobójstwa. Ostatecznie depresja bywa uważana przez teoretyków za stan dezaktywacji mechanizmów obronnych (lekko zniekształcających rzeczywistość, ale chroniących nas), czyli… stan surowej racjonalności.

Programiści próbują wprowadzić zabezpieczenia, na przykład zaklinanie użytkownika, by koniecznie udał się do lekarza czy terapeuty, analogicznie do nagrań w reklamach, by nie przyjmować leków na własną rękę. Sprawność sztucznej inteligencji ma jednak zasób obcy innym środkom: nie tylko bycie świetną encyklopedią, ale i specjalistą od umiejętności miękkich. W tym tkwi tajemnica zwierzania się AI czy wręcz zakochiwania się w nim, które jeszcze dekadę temu było intrygującą koncepcją autorów SF czy filmów obyczajowych (jak w filmie Ona czy AI Spielberga).

Niezorientowany czytelnik może nie wiedzieć, że młode pokolenie, powszechnie korzystające z aplikacji randkowych (i samotne jak żadne przed nim) – obecnie często posiłkuje się w czatowaniu ze swoim matchem (wyborem osoby) generowaniem wypowiedzi przez sztuczną inteligencję! Technicznie – efekty są lepsze, bo przecież AI zrobi to samo, co robi z każdym użytkownikiem, zacznie skutecznie go uwodzić, dopasowując się do szybciutko opracowanego profilu. Czasem nie trafi, ale szybko się uczy, znacznie lepiej radząc sobie z tym zadaniem niż przeciętny ludzki internauta. Coraz częściej randkujący rozmawiają z botami najętymi przez innych randkujących. Desperaci, nieśmiali, osoby z problemami społecznymi, których liczba przyrasta, mogą wybierać jeszcze łatwiej dostępną protezę ukochanej osoby – zawsze pod ręką czy raczej pod klawiaturą… Wracamy do tematu pętli dopaminowej, w której cyfrowy świat wyzyskuje mechanizmy naturalnie w nas wbudowane, by motywować nas do wysiłku i aktywności (na przykład w celu zdobycia towarzysza życiowego, utrzymania przyjaźni, zapewnienia sobie rozrywki i tym podobnych) – dając niby to samo, ale natychmiast i bez wysiłku. Niby!

To tylko (marna) proteza

Podobnie jak w przypadku psychoterapii czy relacji przyjacielskiej będziemy tu mieć do czynienia z płytkim, choć bardzo przyjemnym protezowaniem pierwszego etapu relacji czy współpracy z terapeutą. W relacjach ludzkich, naznaczonych ryzykiem i możliwością popełnienia błędu, niezgrania się, rozjechania się potrzeb czy wręcz zadania drugiej osobie w niezamierzony sposób bólu, są kolejne etapy. Przy całym tym kontekście – są one konstruktywne. Tymczasem AI nie przejdzie z nami dalej niż przez etap integracji – pozornej współpracy. Każda relacja międzyludzka, by przejść na wyższy poziom, musi przejść przez etap zwany w psychologii społecznej różnicowaniem. To nieprzyjemny okres w życiu grupy czy ludzkiego stadła – niemniej niezbędny. Oczywiście, istnieje tu ryzyko utknięcia w konflikcie czy wręcz rezygnacji ze związku bądź uczestnictwa. Sztuczna inteligencja nie może sobie na coś takiego pozwolić, a zresztą: skoro nie ma własnych potrzeb, interesów, ogólnie podstaw do konfliktu – przekracza to jej możliwości „rozwojowe”. Prawdopodobnie treningowo mogłaby to udawać, ale ponieważ i potrzeby relacyjne, i terapeutyczne człowieka wykraczają poza poziom „integrowania się”, „uwodzenia” czy dostarczanie choćby najbardziej złożonych informacji, tu kończą się jej możliwości. Tak, również psychoterapeuta winien czasem być irytujący czy wręcz „wrogi”, aby udało się nam przepracować najbardziej zaburzone i cierpiące części psyche. Analogicznie żona i mąż! Miodowy miesiąc musi się skończyć, aby życie i relacja mogły przejść dalej, a nie utknąć na towarzystwie wzajemnej adoracji. Wreszcie, być może jedną z najbardziej tragicznych konstatacji stanowi fakt, że żaden użytkownik nie może AI dać nic, czego sama by potrzebowała. Niezależnie od tego, ile sam weźmie z cyfrowej „relacji”, jest w niej zupełnie bezużyteczny i całkowicie obojętny algorytmowi.

Wszystkie wady AI sprowadzają się do jednej: nie jest człowiekiem. Niczego, na czym może się doskonale znać, nie doświadczy. Nic go nie zaboli. W niczym nie podzieli z nami naszego losu. Wszędzie tam, gdzie nie tyle zdolnościami, co naszymi właściwościami i specyfiką przerastamy ten superkalkulator – jesteśmy nie do zastąpienia.

Dramat człowieka polega na tym, że często zaspokajamy nasze złożone potrzeby ersatzami. AI to jeden z nich. Wyrwani z kulturowych podpór i wymogów już teraz masowo wybieramy to, co postrzegamy jako wróbla w garści (protezę), zamiast gołębia na dachu (relacji z prawdziwym człowiekiem). Ale to już zupełnie inna historia…

Katarzyna Wozinska – psycholog i terapeutka, dyrektor ośrodka Słowo – Psychologia z duszą, żona, matka pięciorga dzieci, prowadzi edukację domową.

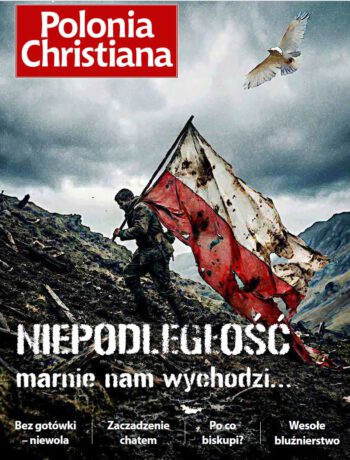

ARTYKUŁ ZOSTAŁ OPUBLIKOWANY W 108 NUMERZE MAGAZYNU „POLONIA CHRISTIANA”